Meta AI làm dấy lên những lo ngại nghiêm trọng về quyền riêng tư: Những điều người dùng cần lưu ý

Các cuộc trò chuyện nhạy cảm bị chia sẻ công khai mà không có cảnh báo rõ ràng từ Meta - các chuyên gia gọi đây là “thảm họa quyền riêng tư”.

Mặc dù cung cấp nhiều tính năng tiên tiến, ứng dụng này cũng đã làm dấy lên những lo ngại nghiêm trọng về quyền riêng tư. Nhiều chuyên gia, người dùng và các tổ chức bảo vệ quyền riêng tư cho rằng các lựa chọn thiết kế của Meta đang đặt dữ liệu cá nhân nhạy cảm vào tình trạng rủi ro.

Meta AI là gì?

Meta AI là một ứng dụng tích hợp giữa chatbot trò chuyện thông minh và mạng xã hội (MXH), cho phép người dùng tương tác với AI để đặt câu hỏi, xin lời khuyên hoặc thảo luận về các chủ đề đa dạng - từ sức khỏe, pháp lý, tâm lý đến đời sống cá nhân.

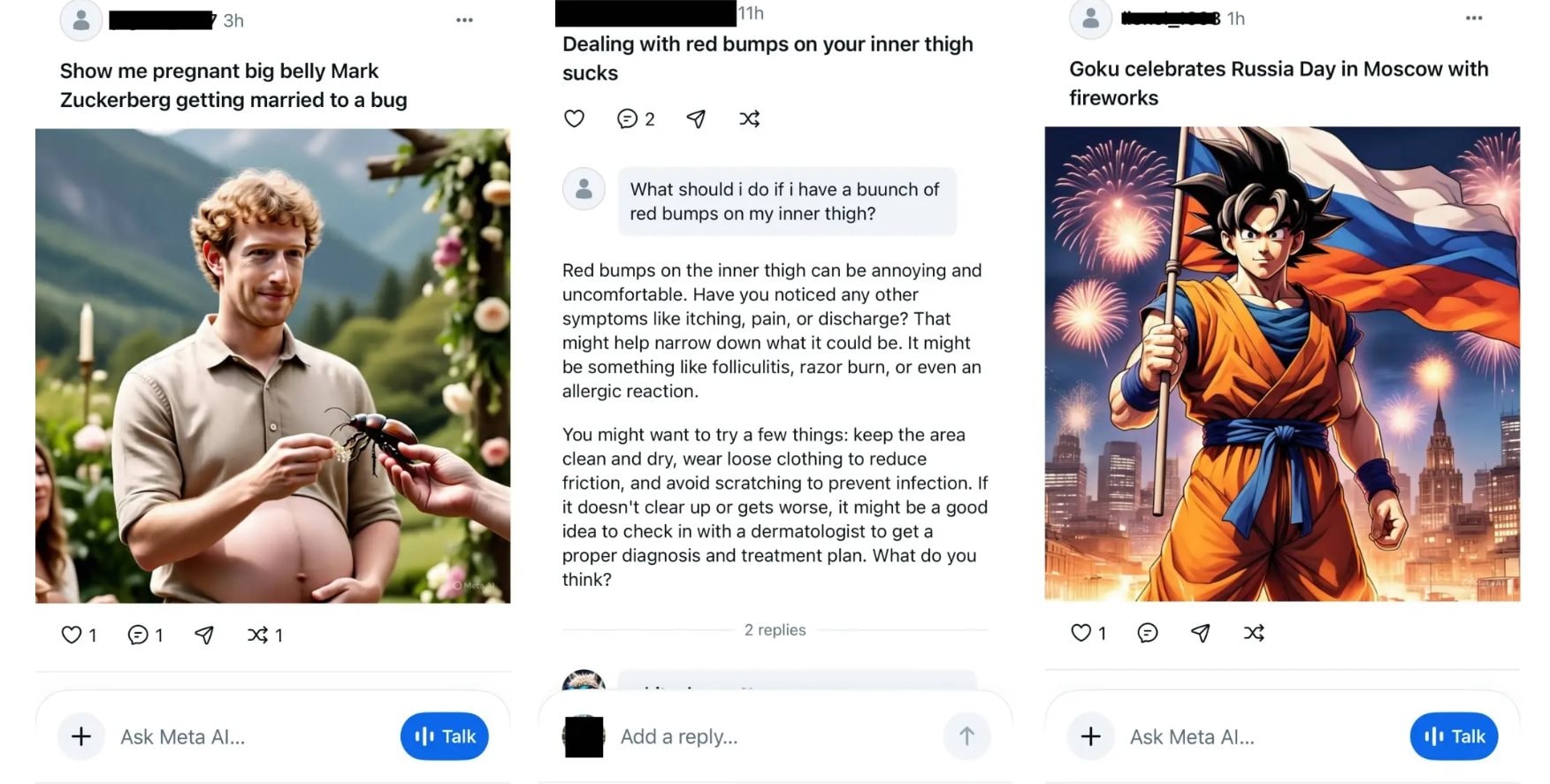

Tuy nhiên, một tính năng đặc biệt của ứng dụng - nguồn cấp dữ liệu “Discover” (Khám phá) - đang làm dấy lên những lo ngại lớn. Tại đây, bất kỳ ai sử dụng ứng dụng đều có thể truy cập vào nguồn cấp dữ liệu này và xem các cuộc trò chuyện mà người khác đã thảo luận với AI được chia sẻ công khai.

Thoạt nhìn, đây có thể được xem như một cách vô hại để chia sẻ những trao đổi thú vị, nhưng thực tế cho thấy nhiều cuộc trò chuyện được chia sẻ lại vô tình chứa thông tin cá nhân nhạy cảm, mà người dùng có thể không nhận ra đang bị công khai.

Từ riêng tư đến công khai: Ranh giới mờ nhạt

Mặc dù Meta tuyên bố các cuộc trò chuyện mặc định là riêng tư, nhưng ứng dụng này khuyến khích chia sẻ theo những cách không phải lúc nào cũng rõ ràng với người dùng. Một nút "Chia sẻ" đơn giản cho phép đăng nhanh cuộc trò chuyện lên nguồn cấp dữ liệu công khai có tên “Discover”, và ứng dụng không đưa ra cảnh báo rõ ràng hay thông báo cụ thể về mức độ công khai của nội dung được chia sẻ.

Hệ quả là nhiều người dùng có thể vô tình công khai thông tin cá nhân mà không nhận thức đầy đủ về rủi ro. Thậm chí, trong một số trường hợp, những dữ liệu cực kỳ nhạy cảm đã xuất hiện trên nguồn cấp dữ liệu này như: Các vấn đề sức khỏe và bệnh lý; Địa chỉ cá nhân và số điện thoại; Thông tin tài chính và thuế…, đặt ra nhiều lo ngại về quyền riêng tư và an toàn thông tin cá nhân.

Đáng lo ngại hơn, trong nhiều trường hợp, những bài đăng còn hiển thị tên thật của người dùng, do Meta AI liên kết trực tiếp với tài khoản Instagram và Facebook.

Mặc dù các cuộc trò chuyện mặc định là riêng tư, nhưng ứng dụng này khuyến khích chia sẻ theo những cách không phải lúc nào cũng rõ ràng với người dùng.

Mặc dù các cuộc trò chuyện mặc định là riêng tư, nhưng ứng dụng này khuyến khích chia sẻ theo những cách không phải lúc nào cũng rõ ràng với người dùng.

Thiết kế của Meta AI: Rủi ro nghiêm trọng đối với quyền riêng tư người dùng

Nhiều chuyên gia về quyền riêng tư nhận định rằng thiết kế của ứng dụng Meta AI không đơn thuần là một thiếu sót, mà có thể là một lựa chọn có chủ đích. Meta dường như đang cố gắng định hình AI như một trải nghiệm mang tính xã hội, khuyến khích người dùng chia sẻ rộng rãi các tương tác của mình.

Tuy nhiên, chính cách tiếp cận này lại tiềm ẩn nhiều rủi ro nghiêm trọng, đặc biệt là đối với quyền riêng tư và bảo mật thông tin cá nhân.

Dữ liệu nhạy cảm bị tiết lộ

Nguồn cấp dữ liệu công khai “Discover” đang vô tình trở thành nơi lưu trữ nhiều thông tin cá nhân nhạy cảm mà người dùng có lẽ chưa từng có ý định chia sẻ với người lạ. Những thông tin này có thể bao gồm tình trạng sức khỏe, vướng mắc pháp lý, vấn đề tâm lý và nhiều nội dung riêng tư khác. Nếu rơi vào tay tội phạm mạng hoặc các đối tượng có ý đồ xấu, những dữ liệu này có thể bị lợi dụng để lừa đảo, đánh cắp danh tính hoặc quấy rối người dùng, gây ra hậu quả nghiêm trọng cả về tinh thần lẫn tài chính.

Cài đặt quyền riêng tư gây nhầm lẫn

Mặc dù ứng dụng có cung cấp các tùy chọn kiểm soát quyền riêng tư, nhưng chúng thường được ẩn sâu trong các tầng menu cài đặt, gây khó khăn cho người dùng phổ thông trong việc tìm thấy và sử dụng. Nhiều người thậm chí không biết rằng những tùy chọn này tồn tại, dẫn đến việc vô tình chia sẻ công khai thông tin cá nhân mà họ tưởng rằng vẫn đang được giữ kín.

Kết nối với tài khoản mạng xã hội

Do Meta AI được tích hợp trực tiếp với các nền tảng như Facebook và Instagram, các bài đăng công khai trên “Discover” thường hiển thị tên thật, ảnh đại diện và các thông tin nhận diện khác của người dùng. Điều này khiến người khác dễ dàng truy ra danh tính người đã chia sẻ các cuộc trò chuyện riêng tư.

“Dark patterns” - thiết kế giao diện đánh lừa người dùng

Nhiều chuyên gia cho rằng giao diện của ứng dụng Meta AI sử dụng cái gọi là “dark patterns” - tức là các thiết kế giao diện có chủ đích gây nhầm lẫn nhằm hướng người dùng đưa ra quyết định mà họ có thể không hiểu rõ. Trong trường hợp này, ứng dụng khiến việc chia sẻ nội dung riêng tư trở nên dễ dàng, trong khi lại khiến người dùng khó nhận biết những rủi ro tiềm ẩn.

Ví dụ, nút chia sẻ được đặt nổi bật và dễ truy cập, trong khi các tùy chọn kiểm soát quyền riêng tư lại bị ẩn kỹ trong nhiều lớp menu, không có hướng dẫn rõ ràng.

Thiết kế như vậy không chỉ làm suy giảm quyền kiểm soát thông tin cá nhân của người dùng, mà còn đặt họ vào tình thế dễ bị tổn thương trước các rủi ro về lừa đảo, xâm phạm quyền riêng tư hoặc quấy rối trên mạng.

Meta thu thập và sử dụng dữ liệu người dùng như thế nào?

Những lo ngại về quyền riêng tư không chỉ dừng lại ở tính năng chia sẻ nội dung. Meta AI còn thu thập và xử lý một lượng lớn dữ liệu cá nhân từ người dùng theo những cách khiến nhiều chuyên gia quan ngại:

Tích hợp dữ liệu từ các nền tảng khác: Meta AI sử dụng thông tin từ Facebook, Instagram và các dịch vụ khác trong hệ sinh thái Meta để cá nhân hóa câu trả lời, mở rộng khả năng hiểu ngữ cảnh người dùng nhưng đồng thời làm mờ ranh giới giữa các nền tảng riêng tư.

Lưu trữ và sử dụng cuộc trò chuyện: Theo mặc định, các cuộc trò chuyện với AI được lưu lại và có thể được sử dụng để huấn luyện các mô hình trong tương lai. Dù người dùng có tùy chọn xóa lịch sử trò chuyện, quy trình này lại khá phức tạp, thiếu hướng dẫn rõ ràng và không đảm bảo toàn bộ dữ liệu được loại bỏ triệt để.

Các tài liệu nội bộ cũng cho thấy Meta có kế hoạch tự động hóa quy trình kiểm duyệt, bao gồm việc đánh giá mức độ an toàn và quyền riêng tư của AI. Tuy nhiên, một số trường hợp phức tạp vẫn có thể cần đến sự can thiệp của con người.

Những thực tiễn này đặt ra câu hỏi lớn về tính minh bạch và trách nhiệm giải trình trong việc xử lý dữ liệu cá nhân, đặc biệt khi người dùng không được thông tin đầy đủ hoặc không có quyền kiểm soát thực chất đối với dữ liệu của chính mình.

Chuyên gia và người dùng nói gì?

Nhiều chuyên gia công nghệ, tổ chức bảo vệ quyền riêng tư và người dùng đã bày tỏ lo ngại sâu sắc trước cách vận hành của ứng dụng Meta AI, đặc biệt là liên quan đến quyền riêng tư và an toàn dữ liệu cá nhân.

Theo đó, các tổ chức bảo mật cảnh báo rằng phần lớn người dùng không nhận thức đầy đủ việc các cuộc trò chuyện với AI có thể bị chia sẻ công khai, dẫn đến nguy cơ tiết lộ thông tin nhạy cảm một cách vô tình.

Nhiều nhà phân tích công nghệ gọi Meta AI là một “thảm họa về quyền riêng tư”, ví nguồn cấp dữ liệu Discover như một “bộ phim kinh dị kỹ thuật số” - nơi người dùng tự tay công khai những bí mật riêng tư nhất của mình mà không hề hay biết.

Trong khi đó, các chuyên gia an ninh mạng nhấn mạnh việc chia sẻ cuộc trò chuyện gắn với tên thật và hồ sơ cá nhân tạo ra rủi ro nghiêm trọng cho sự an toàn cá nhân.

Các nhà nghiên cứu trong lĩnh vực phần mềm độc hại và bảo mật trực tuyến cũng cho rằng Meta chưa cung cấp đầy đủ cảnh báo cho người dùng về nguy cơ khi liên kết dữ liệu AI với tài khoản MXH. Họ cho rằng người dùng cần được thông tin rõ ràng hơn về cách dữ liệu của họ đang được xử lý, chia sẻ và lưu trữ.

Vấn đề pháp lý và đạo đức: Meta AI có thể đối mặt với làn sóng chỉ trích toàn cầu

Ứng dụng Meta AI, mặc dù mới ra mắt nhưng đã nhanh chóng vướng vào các tranh cãi liên quan đến quyền riêng tư, không chỉ dừng lại ở những vấn đề kỹ thuật, mà còn đặt ra câu hỏi lớn về trách nhiệm pháp lý và đạo đức trong thiết kế sản phẩm công nghệ.

Khả năng vi phạm pháp luật bảo vệ dữ liệu

Các đạo luật như Quy định chung về bảo vệ dữ liệu (GDPR) của Liên minh châu Âu (EU) và Đạo luật Quyền riêng tư người tiêu dùng California (CCPA) của Mỹ yêu cầu các công ty công nghệ phải có được sự đồng ý rõ ràng trước khi thu thập hoặc chia sẻ dữ liệu cá nhân.

Tuy nhiên, thiết kế của Meta AI, đặc biệt là tính năng chia sẻ cuộc trò chuyện thông qua nguồn cấp “Discover” bị cho là thiếu minh bạch, dễ gây nhầm lẫn. Việc khuyến khích người dùng chia sẻ mà không có cảnh báo rõ ràng có thể khiến Meta bị xem là vi phạm quy định hoặc thậm chí là có hành vi lừa dối người dùng.

Vi phạm chuẩn mực đạo đức trong công nghệ

Người dùng thường kỳ vọng rằng những cuộc trò chuyện với AI, đặc biệt liên quan đến vấn đề cá nhân, tâm lý, sức khỏe, sẽ được giữ kín hoàn toàn. Nhưng Meta AI lại thiết kế ứng dụng theo hướng khuyến khích chia sẻ, nhiều khi là vô tình, phá vỡ ranh giới giữa riêng tư và công khai.

Thiết kế này khiến nhiều người nhớ đến các vụ bê bối dữ liệu trong quá khứ, chẳng hạn như Meta bị cáo buộc cho phép bên thứ ba như Cambridge Analytica khai thác dữ liệu người dùng mà không được sự đồng ý.

Meta đã nhiều lần phải đối mặt với các khoản phạt và các hành động pháp lý tại nhiều quốc gia khác nhau. Tại châu Âu, cơ quan chức năng đã xử phạt Meta vì vi phạm quyền riêng tư, trong khi Brazil cũng tiến hành các thủ tục pháp lý liên quan đến cách công ty thu thập dữ liệu để huấn luyện AI. Những thách thức pháp lý này có thể tiếp tục gia tăng, đặc biệt nếu các cơ quan quản lý chuyển sự chú ý sang ứng dụng Meta AI mới.

Những thay đổi Meta có thể buộc phải thực hiện

Trước áp lực gia tăng từ dư luận và cơ quan quản lý, Meta có thể buộc phải thực hiện những thay đổi đáng kể đối với ứng dụng AI của mình nhằm giải quyết các lo ngại về quyền riêng tư.

Thiết kế lại ứng dụng: Công ty có thể cần đặt mặc định các cuộc trò chuyện ở chế độ riêng tư và bổ sung cảnh báo rõ ràng, dễ hiểu trước khi người dùng chia sẻ bất kỳ nội dung nào. Quy trình chia sẻ công khai cũng nên được thiết kế minh bạch hơn, nhằm tránh việc người dùng vô tình tiết lộ thông tin cá nhân.

Cải thiện cài đặt quyền riêng tư: Các công cụ kiểm soát quyền riêng tư cần được bố trí dễ tìm, dễ sử dụng và thân thiện hơn. Người dùng không nên phải tìm kiếm qua nhiều menu phức tạp chỉ để bảo vệ dữ liệu cá nhân của mình.

Các cơ quan quản lý tại Mỹ, châu Âu và nhiều quốc gia khác có thể sẽ mở cuộc điều tra nhằm xác định liệu Meta có vi phạm các quy định về bảo vệ dữ liệu hay không. Nếu họ phát hiện ra vấn đề, Meta có thể phải đối mặt với các khoản tiền phạt, hạn chế về chức năng, hoặc buộc phải điều chỉnh thiết kế ứng dụng theo yêu cầu của tòa án.

Nếu không giải quyết triệt để các vấn đề này có thể khiến Meta đánh mất niềm tin từ người dùng. Trong bối cảnh lo ngại ngày càng gia tăng về cách các tập đoàn công nghệ thu thập và sử dụng dữ liệu cá nhân, một bê bối nghiêm trọng về quyền riêng tư có thể giáng đòn mạnh vào tham vọng mở rộng các tính năng AI trên hệ sinh thái sản phẩm của Meta như Facebook, Instagram, Messenger và WhatsApp.

Meta AI mang đến nhiều tính năng vượt trội, nhưng thiết kế hiện tại đang tạo ra những nguy cơ nghiêm trọng đối với quyền riêng tư. Trước làn sóng cảnh báo từ giới chuyên gia và cơ quan quản lý, Meta đang phải đối mặt với áp lực ngày càng lớn để khắc phục những bất cập này. Điều cấp thiết là phải thiết lập các biện pháp bảo vệ quyền riêng tư rõ ràng, cung cấp cảnh báo mạnh mẽ cho người dùng trước khi chia sẻ thông tin, đồng thời cải tiến các công cụ kiểm soát sao cho dễ tiếp cận và dễ sử dụng hơn.

Sự phát triển của AI không nên được đánh đổi bằng quyền riêng tư cá nhân. Chỉ khi được thiết kế một cách cẩn trọng, với các rào chắn bảo mật mạnh mẽ, các ứng dụng AI mới thực sự mang lại giá trị tích cực cho người dùng mà không gây tổn hại đến họ./.