Meta giới thiệu Chameleon, mô hình đa phương tiện đẳng cấp

Khi sự cạnh tranh trong lĩnh vực trí tuệ nhân tạo (AI) sáng tạo chuyển sang các mô hình đa phương tiện, Meta đã công bố một phiên bản xem trước của những gì có thể trở thành câu trả lời của họ cho các mô hình được phát hành bởi các phòng thí nghiệm tiên phong. Chameleon, gia đình mô hình mới của Meta, được thiết kế để tự nhiên đa phương tiện thay vì gộp các thành phần với các phương tiện khác nhau.

Mặc dù Meta chưa phát hành các mô hình, những thí nghiệm được báo cáo của Meta cho thấy Chameleon đạt hiệu suất đẳng cấp thế giới trong nhiều tác vụ, bao gồm phụ đề hình ảnh và trả lời câu hỏi theo hình ảnh (VQA), đồng thời vẫn cạnh tranh trong các tác vụ chỉ có văn bản. Kiến trúc của Chameleon có thể mở ra các ứng dụng trí tuệ nhân tạo mới yêu cầu sự hiểu biết sâu sắc về cả thông tin hình ảnh và văn bản.

Cách phổ biến để tạo các mô hình nền tảng đa phương tiện là ghép nối các mô hình đã được đào tạo cho các phương tiện khác nhau. Cách tiếp cận này được gọi là "hợp nhất muộn". Mặc dù hợp nhất muộn hoạt động tốt, nhưng nó hạn chế khả năng của các mô hình tích hợp thông tin trên các phương tiện và tạo ra các chuỗi hình ảnh và văn bản được xen kẽ.

VentureBeat được tạo ra bằng OpenAI DALL-E 3.

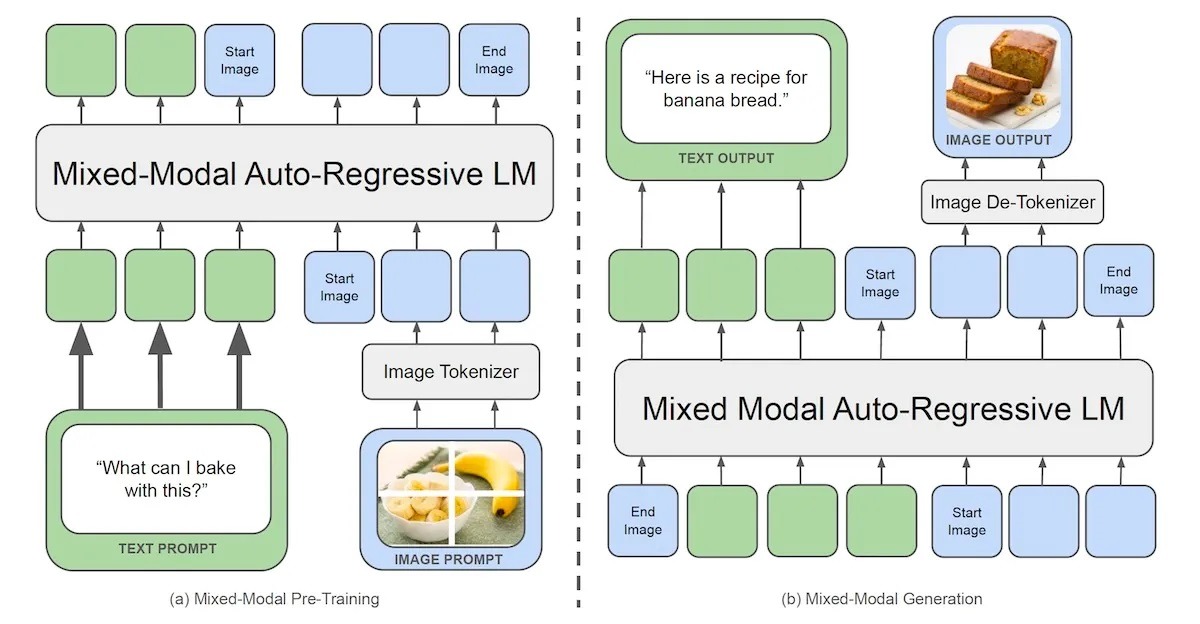

Chameleon sử dụng kiến trúc "hợp nhất sớm dựa trên token đa phương tiện hỗn hợp", có nghĩa là nó được thiết kế ngay từ đầu để học từ một hỗn hợp các hình ảnh, văn bản, mã và các phương tiện khác được xen kẽ. Chameleon biến đổi hình ảnh thành các token rời rạc, giống như các mô hình ngôn ngữ làm với từ. Nó cũng sử dụng một bộ từ vựng thống nhất bao gồm các token văn bản, mã và hình ảnh. Điều này làm cho việc áp dụng cùng một kiến trúc transformer đối với các chuỗi chứa cả token hình ảnh và văn bản trở nên có thể.

Mô hình tương tự nhất với Chameleon là Google Gemini, cũng sử dụng cách tiếp cận dựa trên token hợp nhất sớm. Tuy nhiên, Gemini sử dụng các bộ giải mã hình ảnh riêng biệt trong giai đoạn tạo, trong khi Chameleon là một mô hình hoàn chỉnh cả xử lý và tạo ra token. Không gian token thống nhất của Chameleon cho phép nó suy luận và tạo ra các chuỗi hình ảnh và văn bản xen kẽ một cách mạch lạc, mà không cần các thành phần cụ thể cho phương tiện.

Mặc dù hợp nhất sớm rất hấp dẫn, nhưng nó đặt ra những thách thức đáng kể khi đào tạo và mở rộng quy mô mô hình. Để vượt qua những thách thức này, các nhà nghiên cứu đã áp dụng một loạt các điều chỉnh kiến trúc và kỹ thuật đào tạo, được chi tiết trong bài báo của họ.

Quá trình đào tạo Chameleon diễn ra trong hai giai đoạn, với một tập dữ liệu chứa 4,4 nghìn tỷ token văn bản, cặp hình ảnh-văn bản và các chuỗi văn bản và hình ảnh xen kẽ. Các nhà nghiên cứu đã đào tạo phiên bản có 7 tỷ và 34 tỷ tham số của Chameleon trên hơn 5 triệu giờ GPU Nvidia A100 80GB.

Logic mã hóa và giải mã của Chameleon (nguồn: arxiv).

Theo các thí nghiệm được báo cáo, Chameleon có thể thực hiện một loạt các nhiệm vụ chỉ có văn bản và đa phương tiện. Trên các bộ đánh giá trả lời câu hỏi theo hình ảnh (VQA) và phụ đề hình ảnh, Chameleon-34B đạt hiệu suất đẳng cấp thế giới, vượt trội so với các mô hình như Flamingo, IDEFICS và Llava-1.5. Theo các nhà nghiên cứu, Chameleon đạt hiệu suất tương đương các mô hình khác với ít ví dụ đào tạo nội tuyến hơn và kích thước mô hình nhỏ hơn, trong cả đánh giá mô hình tiền đào tạo và tinh chỉnh.

Mặt khác, một sự đánh đổi của tính đa phương tiện là sự giảm hiệu suất trong các yêu cầu phương tiện đơn. Ví dụ, các mô hình ngôn ngữ-hình ảnh có xu hướng có hiệu suất thấp hơn trên các câu đầu vào chỉ có văn bản. Tuy nhiên, Chameleon vẫn cạnh tranh trên các bộ đánh giá chỉ có văn bản, đạt hiệu suất tương đương các mô hình như Mixtral 8x7B và Gemini-Pro trên nhiệm vụ suy luận thông thường và đọc hiểu.

Điểm đáng chú ý, Chameleon có thể mở ra khả năng mới cho việc suy luận và tạo ra đa phương tiện hỗn hợp, đặc biệt khi các câu đầu vào mong đợi phản hồi đa phương tiện với văn bản và hình ảnh xen kẽ. Các thí nghiệm với phản hồi được đánh giá bởi con người cho thấy nhìn chung, người dùng ưu tiên các tài liệu đa phương tiện do Chameleon tạo ra.

Vừa qua, cả OpenAI và Google đều công bố các mô hình mới cung cấp trải nghiệm đa phương tiện phong phú. Tuy nhiên, họ chưa công bố nhiều chi tiết về các mô hình đó. Nếu Meta tiếp tục công khai phát hành các "trọng lượng" (weights) của mô hình này, điều đó có nghĩa là bất kỳ ai cũng có thể tải về và sử dụng mô hình cho các ứng dụng của riêng mình.

Việc phát hành trọng lượng mô hình miễn phí giúp Chameleon trở thành một "lựa chọn mở" cho các mô hình ngôn ngữ riêng tư, vì người dùng không cần phải huấn luyện lại mô hình từ đầu mà có thể sử dụng mô hình đã được huấn luyện trước đó bởi Meta.

Điều này khác với các mô hình thương mại hóa chỉ cung cấp API truy cập, vì người dùng có thể triển khai Chameleon trên phần cứng riêng để xử lý dữ liệu nhạy cảm mà không cần phải chia sẻ dữ liệu đó với bên thứ ba.

Hợp nhất sớm cũng có thể thúc đẩy các hướng nghiên cứu mới cho các mô hình tiên tiến hơn, đặc biệt khi thêm nhiều phương tiện vào hỗn hợp. Ví dụ, các startup robot đã bắt đầu thử nghiệm việc tích hợp các mô hình ngôn ngữ vào hệ thống điều khiển robot. Sẽ rất thú vị để xem hợp nhất sớm có thể cải thiện các mô hình nền tảng robot như thế nào.

"Chameleon đại diện cho một bước tiến quan trọng trong việc hiện thực hóa tầm nhìn về các mô hình nền tảng thống nhất có khả năng suy luận và tạo ra nội dung đa phương tiện một cách linh hoạt," các nhà nghiên cứu cho biết.

Theo Tạp chí Điện tử và Ứng dụng

https://dientuungdung.vn/meta-gioi-thieu-chameleon-mo-hinh-da-phuong-tien-dang-cap