Google giới thiệu mô hình AI mới có khả năng nhận diện cảm xúc

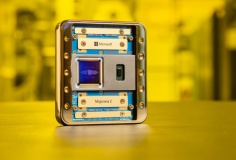

Google vừa công bố dòng mô hình AI mới mang tên PaliGemma 2, với khả năng đáng chú ý: nhận diện cảm xúc từ hình ảnh. Tính năng này cho phép AI không chỉ tạo ra chú thích cho ảnh mà còn phân tích hành động, cảm xúc của những người hiện hữu trong bức ảnh.

Trong một bài viết trên blog chia sẻ với TechCrunch, Google nhấn mạnh rằng "PaliGemma 2 tạo ra các chú thích chi tiết, có liên quan đến ngữ cảnh cho hình ảnh, vượt ra ngoài việc chỉ nhận diện đối tượng đơn giản."

Mặc dù khả năng nhận diện cảm xúc không phải là tính năng mặc định và cần chỉnh sửa thêm, nhưng một số chuyên gia đã bày tỏ những lo ngại về việc công khai phát hành công nghệ này. "Sự việc này khiến tôi cảm thấy rất lo lắng," Sandra Wachter, giáo sư về đạo đức dữ liệu và AI tại Viện Internet Oxford, chia sẻ. "Tôi thấy khó chấp nhận khi cho rằng chúng ta có thể 'đọc' được cảm xúc của người khác, giống như hỏi một quả cầu pha lê để xin lời khuyên vậy."

Nhiều công ty công nghệ và khởi nghiệp đã nỗ lực phát triển AI có khả năng phát hiện cảm xúc trong nhiều lĩnh vực, từ đào tạo bán hàng đến phòng ngừa tai nạn. Mặc dù một số tuyên bố rằng họ đã đạt được tiến bộ, nhưng cơ sở khoa học hỗ trợ cho những tuyên bố này vẫn còn yếu.

Nguồn hình ảnh: Liên minh hình ảnh / Người đóng góp(mở trong cửa sổ mới)/ Hình ảnh Getty

Hầu hết các hệ thống phát hiện cảm xúc dựa trên nghiên cứu ban đầu của Paul Ekman, người đã đề xuất rằng có sáu cảm xúc cơ bản mà con người chia sẻ: tức giận, ngạc nhiên, ghê tởm, thích thú, sợ hãi và buồn bã. Tuy nhiên, những nghiên cứu sau này đã chỉ ra rằng sự biểu hiện cảm xúc của con người có sự khác biệt lớn tùy theo nền văn hóa và bối cảnh.

“Việc phát hiện cảm xúc là một nhiệm vụ phức tạp,” Mike Cook, một nhà nghiên cứu AI từ Đại học Queen Mary, nói. “Chúng tôi có thể nghĩ rằng mình có thể nhận biết được cảm xúc của người khác chỉ bằng cách nhìn vào họ, nhưng thực tế là con người trải qua cảm xúc một cách rất đa dạng.”

Hậu quả không thể dự đoán được từ việc phát hiện cảm xúc đôi khi dẫn đến những kết quả sai lệch và thiên lệch. Một nghiên cứu của MIT năm 2020 cho thấy các mô hình phân tích khuôn mặt có xu hướng phát triển sở thích không mong muốn đối với những biểu cảm như mỉm cười. Thậm chí, những nghiên cứu gần đây đã phát hiện rằng các mô hình phân tích cảm xúc thường gán nhiều cảm xúc tiêu cực hơn cho các khuôn mặt của người da đen so với người da trắng.

Mặc dù Google đã thông báo rằng họ đã thực hiện các thử nghiệm để xác định các thiên lệch nhân khẩu học trong PaliGemma 2 và cho rằng công nghệ này đạt "mức độ độc hại và tục tĩu thấp," nhưng họ không công bố các tiêu chí chính xác hay loại thử nghiệm đã được thực hiện. Chỉ tiêu chuẩn FairFace, một tập hợp gồm hàng chục nghìn bức chân dung, được Google đề cập, nhưng nhiều nhà nghiên cứu đã chỉ trích tiêu chuẩn này vì không đại diện đầy đủ cho nhiều nhóm chủng tộc khác nhau.

Heidy Khlaaf, nhà khoa học AI trưởng tại Viện AI Now, nhấn mạnh: "Việc giải thích cảm xúc là một vấn đề rất chủ quan, không thể đơn thuần dựa vào những đặc điểm trực quan và thường bị ảnh hưởng bởi bối cảnh cá nhân và văn hóa." Bà cũng cho biết rằng các nghiên cứu đã chứng minh chúng ta không thể suy luận cảm xúc từ sự biểu hiện trên khuôn mặt một cách đơn giản.

Tại châu Âu, các cơ quan quản lý đã bày tỏ sự lo ngại về hệ thống AI nhận diện cảm xúc, nhất là trong các lĩnh vực có nguy cơ cao. Đạo luật AI của Liên minh châu Âu đã cấm các trường học và người sử dụng lao động áp dụng công nghệ này, ngoại trừ trong công tác thực thi pháp luật.

Một trong những mối lo ngại lớn nhất đối với các mô hình AI như PaliGemma 2, được phát hành công khai trên nhiều nền tảng phát triển, là khả năng bị lạm dụng hoặc sử dụng sai mục đích, dẫn đến tác hại trong thực tế. Khlaaf cảnh báo: "Nếu công nghệ nhận diện cảm xúc dựa trên những giả định chưa được kiểm chứng, điều này có thể dẫn đến những hệ lụy nghiêm trọng, bao gồm phân biệt đối xử với các nhóm thiểu số trong nhiều bối cảnh khác nhau như công tác thực thi pháp luật hay quản lý nguồn nhân lực."

Khi được hỏi về các nguy cơ liên quan đến việc phát hành PaliGemma 2, một người phát ngôn của Google cho biết công ty đang tiến hành các thử nghiệm về "tác hại liên quan đến việc nhìn nhận và chú thích". Họ cũng nói thêm: "Chúng tôi đã thực hiện một đánh giá chặt chẽ về mô hình PaliGemma 2 nhằm đảm bảo các yếu tố đạo đức và an toàn, từ an toàn cho trẻ em đến an toàn nội dung."

Tuy nhiên, Wachter không tin rằng những biện pháp này là đủ. Bà nói: "Đổi mới một cách có trách nhiệm có nghĩa là bạn cần phải suy nghĩ về các hậu quả ngay từ những ngày đầu tiên khi bắt đầu nghiên cứu và duy trì điều đó trong suốt vòng đời của sản phẩm." Bà cảnh báo rằng với các mô hình như vậy, có thể xuất hiện rất nhiều vấn đề tiềm ẩn, gây ra một tương lai đáng lo ngại, nơi cảm xúc của mỗi người sẽ ảnh hưởng đến khả năng họ nhận được công việc, khoản vay, hay thậm chí là việc được nhận vào trường đại học.

Kỷ niệm 115 năm Ngày Bác Hồ ra đi tìm đường cứu nước (5/6/1911 – 5/6/2026): Dấu chân Người từng in khắp bốn biển năm châu

Kỷ niệm 115 năm Ngày Bác Hồ ra đi tìm đường cứu nước (5/6/1911 – 5/6/2026): Dấu chân Người từng in khắp bốn biển năm châu

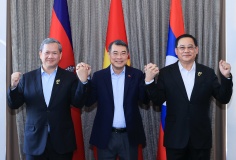

Phó Thủ tướng Thường trực Phạm Gia Túc nêu 3 định hướng hợp tác lớn tại Diễn đàn kinh tế quốc tế Saint Petersburg lần thứ 29

Phó Thủ tướng Thường trực Phạm Gia Túc nêu 3 định hướng hợp tác lớn tại Diễn đàn kinh tế quốc tế Saint Petersburg lần thứ 29