Cải thiện phát hiện Deepfake thông qua đưa vào nhận thức đa dạng nhân khẩu học

Deepfake, công nghệ cho phép tạo ra những video và hình ảnh mà trong đó người khác dường như nói hoặc làm những điều mà họ chưa từng thực hiện, đã trở nên tinh vi hơn bao giờ hết.

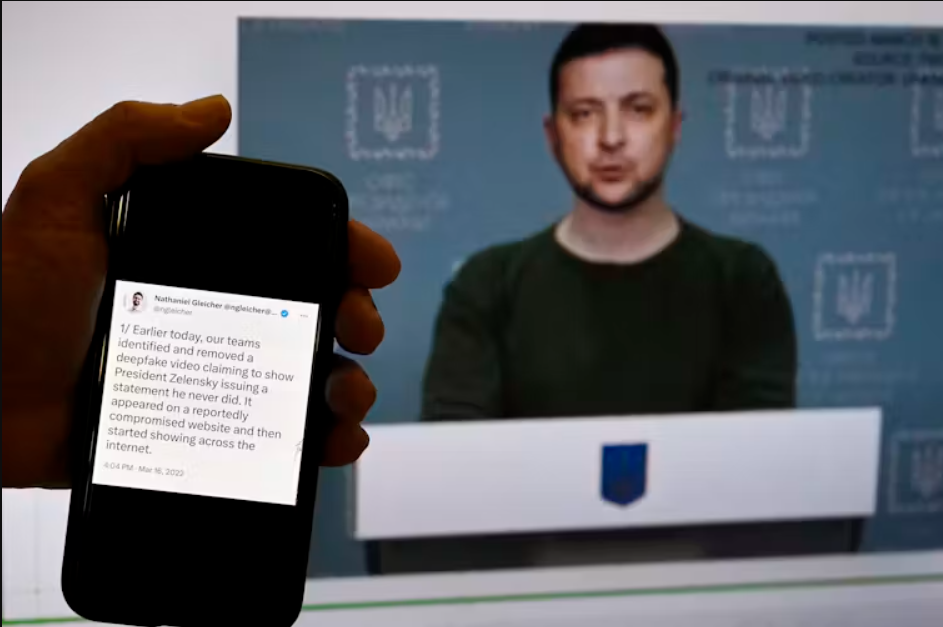

Những ví dụ gần đây, chẳng hạn như hình ảnh khỏa thân của Taylor Swift , bản ghi âm Tổng thống Joe Biden nói với người dân New Hampshire không bỏ phiếu và video Tổng thống Ukraine Volodymyr Zelenskyy kêu gọi quân đội hạ vũ khí.

Mặc dù đã có những công cụ được phát triển để phát hiện deepfake, nhưng nghiên cứu chỉ ra rằng sự thiên lệch trong dữ liệu huấn luyện có thể dẫn đến việc một số nhóm nhân khẩu học bị nhắm mục tiêu không công bằng. Để giải quyết vấn đề này, nhóm nghiên cứu của chúng tôi đã tiến hành khám phá những phương pháp mới nhằm cải thiện cả độ chính xác và tính công bằng trong phát hiện deepfake.

Chúng tôi đã sử dụng một tập dữ liệu lớn chứa các khuôn mặt giả mạo để đào tạo các thuật toán học sâu, dựa trên nền tảng Xception – một trong những thuật toán hiện đại phổ biến nhất trong phát hiện deepfake, với độ chính xác cơ bản đạt 91,5%.

Cải thiện phát hiện Deepfake thông qua đưa vào nhận thức đa dạng nhân khẩu học

Trong nghiên cứu của mình, chúng tôi đã phát triển hai phương pháp phát hiện deepfake. Phương pháp đầu tiên tập trung vào việc gán nhãn dữ liệu theo giới tính và chủng tộc, nhằm giúp thuật toán hiểu rõ hơn về sự đa dạng nhân khẩu học, từ đó giảm thiểu sai sót đối với những nhóm chưa được đại diện đầy đủ. Phương pháp thứ hai lại tìm cách cải thiện tính công bằng mà không sử dụng nhãn nhân khẩu học, bằng cách chú trọng vào các đặc điểm mà mắt người không nhìn thấy được.

Kết quả cho thấy, phương pháp đầu tiên mang lại hiệu quả tốt nhất. Độ chính xác của thuật toán đã tăng lên 94,17%, một mức tăng đáng kể so với mức cơ bản, đồng thời cải thiện tính công bằng – yếu tố cốt lõi trong nghiên cứu của chúng tôi.

Chúng tôi tin rằng việc đảm bảo tính chính xác và công bằng trong các thuật toán phát hiện deepfake là vô cùng quan trọng để công chúng có thể tin tưởng vào công nghệ trí tuệ nhân tạo. Khi các mô hình ngôn ngữ lớn như ChatGPT có thể “ảo giác”, việc bảo trì thông tin chính xác là điều cần thiết để giữ vững lòng tin và an toàn cho người dùng. Nếu không có những công cụ phát hiện deepfake hiệu quả, tác động tiêu cực của chúng có thể làm suy yếu sự chấp nhận của xã hội đối với AI.

Nghiên cứu của chúng tôi không chỉ tập trung vào việc cân bằng dữ liệu mà còn đề xuất một phương pháp thiết kế thuật toán sâu sắc hơn, coi tính công bằng về mặt nhân khẩu học như một yếu tố trung tâm. Chúng tôi hy vọng rằng thông qua những cải thiện này, công nghệ phát hiện deepfake sẽ ngày càng trở nên mạnh mẽ và chính xác hơn, góp phần bảo vệ mọi nhóm nhân khẩu học khỏi những tác động tiêu cực của công nghệ.