Một số kỹ thuật và công cụ phát hiện Deepfake

Trong những năm gần đây, công nghệ Deepfake đã trở nên ngày càng phổ biến hơn, cho phép tạo ra các video thực đến mức chúng ta khó có thể phân biệt với các video quay thực tế. Tuy nhiên, công nghệ này đã bị các tác nhân đe dọa lợi dụng để tạo ra những nội dung giả mạo, hoán đổi khuôn mặt nhằm mục đích lừa đảo, gây ảnh hưởng tiêu cực đến xã hội. Do đó, việc phát triển các công cụ phát hiện Deepfake mang tính cấp bách hơn bao giờ hết. Bài viết này sẽ giới thiệu tổng quan về một số kỹ thuật và công cụ phát hiện Deepfake hiệu quả.

TỔNG QUAN VỀ PHÁT HIỆN DEEPFAKE

Phát hiện Deepfake

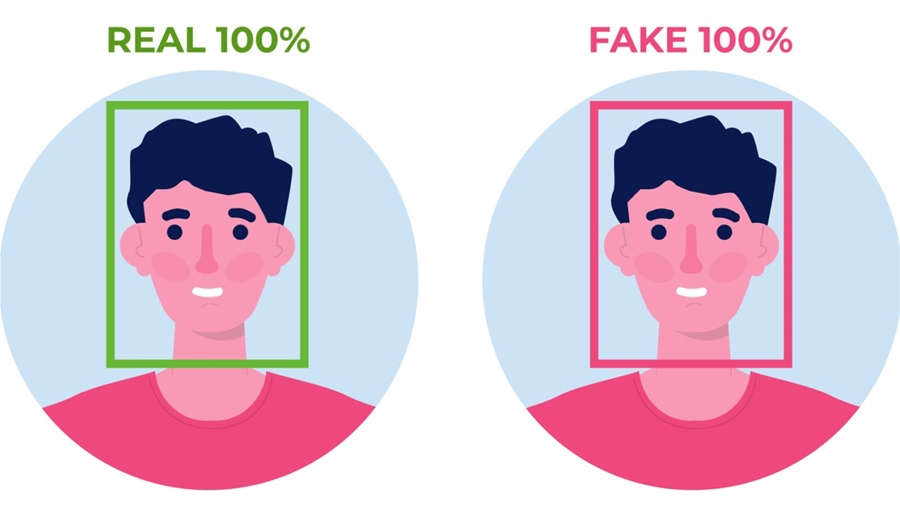

Phát hiện Deepfake là quá trình xác định xem một tệp kỹ thuật số như hình ảnh, âm thanh hoặc video đã được chỉnh sửa hoặc tổng hợp bằng trí tuệ nhân tạo (AI) hay không [1]. Với sự phát triển của công nghệ Deepfake, việc phát hiện Deepfake đã trở thành một nhiệm vụ quan trọng trong việc đảm bảo tính toàn vẹn của phương tiện truyền thông kỹ thuật số. Hiện nay, có nhiều kỹ thuật và công cụ khác nhau được phát triển để phát hiện Deepfake như dựa trên AI, dựa trên ánh mắt,... Những kỹ thuật và công cụ này liên tục phát triển và cải thiện để theo kịp những tiến bộ trong công nghệ Deepfake.

Phát hiện Deepfake không chỉ đơn giản là xác định những tệp kỹ thuật số nào bị thay đổi mà quan trọng hơn đó là ngăn chặn sự lây lan của những thông tin sai lệch, bảo vệ các cá nhân khỏi các sự tác động xấu của các nội dung Deepfake.

Thách thức đặt ra với việc phát hiện Deepfake

Dưới đây là một số thách thức đặt ra đối với việc phát hiện Deepfake [1]:

- Các kỹ thuật tạo Deepfake ngày càng tăng độ phức tạp: Khi các kỹ thuật tạo Deepfake trở nên tinh vi hơn, việc phân biệt các video thực và giả cũng ngày càng khó khăn hơn.

- Hạn chế tính khả dụng của tập dữ liệu đào tạo: Các thuật toán phát hiện Deepfake yêu cầu một lượng lớn dữ liệu được đào tạo để học cách phân biệt giữa các video thực và giả. Tuy nhiên, khi tính khả dụng của dữ liệu đó bị hạn chế lại tạo ra những thách thức cho việc đào tạo các mô hình phát hiện Deepfake một cách chính xác.

- Các máy dò Deepfake dễ bị tấn công: Những kẻ tấn công có thể thay đổi dữ liệu đầu vào để đánh lừa thuật toán phát hiện Deepfake. Điều này có thể dẫn đến dương tính giả hoặc âm tính giả, giảm độ chính xác của hệ thống phát hiện Deepfake.

- Phát hiện theo thời gian thực: Đây là một nhiệm vụ đầy thách thức vì nó yêu cầu xử lý một lượng lớn dữ liệu trong thời gian thực. Điều này gây áp lực cho các tài nguyên tính toán và yêu cầu phần cứng chuyên dụng để đạt được hiệu suất xử lý trong thời gian thực.

- Đảm bảo quyền riêng tư: Phát hiện Deepfake làm tăng các mối quan tâm về quyền riêng tư vì nó liên quan đến việc phân tích và xử lý dữ liệu nhạy cảm như là video và hình ảnh. Điều này đòi hỏi các biện pháp bảo vệ dữ liệu nghiêm ngặt để đảm bảo rằng quyền riêng tư của các cá nhân không bị xâm phạm.

MỘT SỐ KỸ THUẬT THƯỜNG ĐƯỢC SỬ DỤNG ĐỂ PHÁT HIỆN DEEPFAKE

Mạng nơ-ron tích chập

Mạng nơ-ron tích chập (Convolutional Neural Network - CNN) là một trong những mô hình Deep Learning tiên tiến, đây là một loại thuật toán học sâu, thường được sử dụng để phân tích hình ảnh và video. Nó giúp cho chúng ta xây dựng được những hệ thống thông minh với độ chính xác cao như hiện nay [1]. CNN đặc biệt phù hợp để phát hiện Deepfake vì chúng có thể xác định các mẫu và tính năng trong hình ảnh và video mà không thể nhìn thấy bằng mắt thường.

Để phát hiện Deepfake bằng CNN, thuật toán được đào tạo trên một bộ dữ liệu các hình ảnh hoặc các video thực và giả. CNN học cách xác định sự khác biệt tinh tế giữa hình ảnh thực và giả, chẳng hạn như sự khác biệt về ánh sáng, bóng tối và biểu cảm khuôn mặt. Khi CNN đã được đào tạo, nó có thể được sử dụng để phân loại hình ảnh hoặc video là thật hoặc giả với độ chính xác cao.

Bộ mã tự động

Bộ mã tự động (Autoencoder) là mạng nơ-ron tự động mã hóa, một thuật toán học máy không giám sát áp dụng sự lan truyền ngược, đặt các giá trị đích bằng với các đầu vào. Mã tự động được sử dụng để giảm kích thước đầu vào thành một biểu diễn nhỏ hơn. Kiến trúc của này tạo ra “một nút thắt cổ chai” (Hình 1), vì vậy những đặc trưng đại diện được giữ lại [2].

Hình 1. Kiến trúc Autoencoder.

Để phát hiện Deepfake, thuật toán được huấn luyện trên một tập dữ liệu các hình ảnh thực và giả. Autoencoder học cách nén và xây dựng lại dữ liệu đầu vào, học cách xác định sự khác biệt giữa dữ liệu đầu vào thực và giả. Khi autoencoder được đào tạo, nó có thể được sử dụng để phân loại các hình ảnh và video mới là thật hay là giả dựa trên chất lượng của bản dựng lại.

Mạng đối nghịch tạo sinh

Mạng đối nghịch tạo sinh (Generative Adversarial Networks - GAN) là một loại thuật toán học sâu có thể được sử dụng để tạo ra hình ảnh và video chân thực. GAN gồm một trình sinh (Generator) và một trình phân biệt (Discriminator) tương tác với nhau thông qua mối quan hệ đối nghịch. Trình sinh được đào tạo để tạo ra hình ảnh hoặc video giả để đánh lừa trình phân biệt. Đồng thời, trình phân biệt được đào tạo để phân biệt giữa hình ảnh thật và giả, giữa video thật và giả [3].

Để phát hiện Deepfake bằng GAN, thuật toán được đào tạo trên tập dữ liệu gồm cả hình ảnh hoặc video thật và giả. Từ tập dữ liệu hiện có, trình sinh và trình phân biệt của GAN làm việc cùng nhau để tạo ra và phân biệt các mẫu. Khi GAN đã được huấn luyện, nó có thể được sử dụng để phân loại hình ảnh hoặc video là thật hay giả dựa trên đầu ra của trình phân biệt.

Phát hiện Deepfake bằng cách sử dụng sự không phù hợp về hình ảnh tương ứng của âm vị

Phát hiện Deepfake bằng cách sử dụng sự không phù hợp về hình ảnh tương ứng của âm vị là một kỹ thuật khoa học và giải pháp đột phá trong bối cảnh các video Deepfake xuất hiện ngày càng nhiều trên mạng Internet. Công cụ này được phát triển bởi những chuyên gia tại Đại học Stanford và Đại học California (Mỹ) [4]. Mô hình này có thể phát hiện các đặc điểm khuôn mặt nhân tạo và khai thác sự không nhất quán giữa các hình ảnh khuôn dạng miệng và âm vị nói.

MỘT SỐ CÔNG CỤ PHÁT HIỆN DEEPFAKE

FakeCatcher

FakeCatcher là công cụ phát hiện Deepfake trong thời gian thực của Intel. Công cụ này được phát triển bởi sự hợp tác với Đại học Binghamton, có khả năng phát hiện các video giả với tỷ lệ ấn tượng 96% với những kết quả trong thời gian thực. Bằng cách sử dụng phần cứng và phần mềm nâng cao của Intel, FakeCatcher là một công cụ mạnh mẽ có thể phân biệt được các nội dung thực và các nội dung đã bị chỉnh sửa.

FakeCacher hoạt động bằng cách xác định các dấu hiệu xác thực trong các video thực, chẳng hạn như sự chuyển động của các mạch máu trong các pixel của video. Khi tim của chúng ta bơm máu, tĩnh mạch sẽ thay đổi màu sắc và những tín hiệu về lưu lượng máu này được thu thập từ khắp cơ thể của chúng ta. Các thuật toán sẽ dịch các tín hiệu này thành các bản đồ không gian và với sự trợ giúp của các mô hình học sâu, FakeCatcher có thể xác định ngay lập tức một video là thật hay giả [5].

Video Authenticator

Công cụ xác thực video của Microsoft mang tên Video Authenticator là một công cụ phát hiện Deepfake nâng cao, được phát triển bởi đội ngũ các nhà nghiên cứu Microsoft Research, Microsoft AI và Ethics and Effects in Engineering and Research.

Phương thức hoạt động của Video Authenticator về cơ bản không có gì phức tạp, nó sử dụng thuật toán để phân tích ảnh tĩnh hoặc video ở cấp độ pixel mà mắt thường không thể nhìn thấy được, nhằm đưa ra tỷ lệ phần trăm cơ hội hoặc điểm số tin cậy, cho biết khả năng hình ảnh, video đó bị can thiệp Deepfake là bao nhiêu. Đặc biệt đối với video, công cụ có thể cung cấp điểm số đánh giá theo thời gian thực trên mỗi khung hình nhằm đưa ra kết quả chuẩn xác nhất [6].

Công cụ Deepware Scanner

Deepware Scanner là một công cụ điều tra số nguồn mở, chủ yếu dành riêng cho việc phát hiện các video do AI tạo ra. Công cụ này đã đi đầu trong nghiên cứu Deepfake từ năm 2018, phát triển các phương pháp hiệu quả nhất để phát hiện Deepfake. Deepware Scanner cho phép người dùng tải video lên để xác định xem chúng có bị chỉnh sửa bởi AI hay không. Tương tự như các máy dò quét Deepfake khác, các mô hình Deepware tìm kiếm các dấu hiệu thao túng trên khuôn mặt con người. Hạn chế của công cụ này là không có khả năng phát hiện các kỹ thuật hoán đổi giọng nói, điều này nguy hiểm hơn nhiều so với việc hoán đổi khuôn mặt [7].

Công cụ Faceless - bộ công cụ phát hiện Deepfake Make in Viet Nam

Bộ công cụ Faceless là do Dương Tiểu Đồng (sinh năm 2005) và Phạm Tiến Mạnh (sinh năm 1996) nghiên cứu phát triển. Đây là bộ công cụ của Việt Nam, vận hành bằng cách tiếp nhận một hình ảnh từ người dùng và tiến hành nhận diện khuôn mặt. Khuôn mặt đó sẽ được đưa vào mạng “nơ-ron tích chập” để phân loại xem đó có phải là sản phẩm của quá trình Deepfake hay không. Kết quả thử nghiệm cho thấy, Faceless có khả năng phát hiện Deepfake trong vòng dưới 2 giây với độ chính xác 94.5%. Đây cũng là một kết quả phát hiện Deepfake tương đối nổi bật so với một số công cụ hiện có. Hiện nay bộ công cụ đang được chia sẻ dưới dạng mã nguồn mở. Trong tương lai, nhóm nghiên cứu dự kiến sẽ phát triển bộ công cụ phát hiện Deepfake dựa trên đóng góp của cộng đồng và không nhằm mục đích thương mại hóa [8].

|

TÀI LIỆU THAM KHẢO [1]. https://www.straight.com/guides/software/best-deepfake-detector-tools-techniques/. [2]. Tran Tung Nhi, Pham Van Quan, Phan Cong Dat. Ứng dụng kỹ thuật bộ mã tự động tích chập (convolutional autoencoder) trong khử nhiễu hình ảnh. Tạp chí khoa học Đại học Đông Á. 2022. [3]. https://m.mic.gov.vn/pages/tintuc/printpage.aspx?tintucID=145971 [4]. Shruti Agarwal and Hany Farid, Ohad Fried and Maneesh Agrawala. Detecting Deep-Fake Videos from Phoneme-Viseme Mismatches. 2020 IEEE/ CVF Conference on Computer Vision and Pattern Recognition Workshops. 2020. [5] https://aimojo.pro/deepfake-detection-tools/. [7]. https://www.congluan.vn/nhung-cong-cu-ai-de-chong-lai-deepfake-post264819.html. [8]. https://vietnamnet.vn/hacker-mu-trang-viet-phat-trien-cong-cu-phat-hien-deepfake-2166061.html. |

.jpg)