“AI như là một chiếc gương đen”

Bài báo "AI is the Black Mirror" của Philip Ball cung cấp một cái nhìn chi tiết về trí tuệ nhân tạo (AI) và tác động của nó đến nhận thức con người.

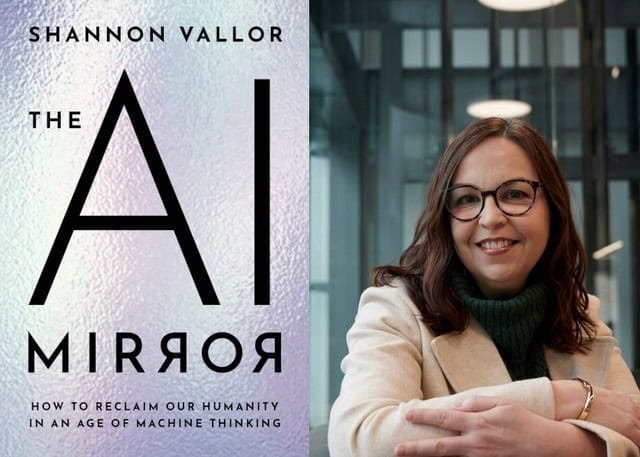

Tiêu đề bài báo gợi nhắc đến series phim nổi tiếng Black Mirror trên Netlix phản ánh những mặt tối và hệ lụy xã hội của công nghệ trong tương lai. Cách so sánh này giúp người đọc dễ hình dung AI như một "chiếc gương đen" phản chiếu những góc khuất của chính con người, dựa trên các quan điểm từ nhà nghiên cứu triết học và nhà đạo đức AI Shannon Vallor trong cuốn sách "The AI Mirror" (2024). Bài báo nhấn mạnh nhiều khía cạnh văn hóa, đạo đức và triết học xoay quanh AI.

Nhà nghiên cứu triết học và nhà đạo đức AI Shannon Vallor trong cuốn sách "The AI Mirror" (2024).

Philip Ball đã phỏng vấn Shannon Vallor tại Thư viện Anh ở London, gần các trung tâm nghiên cứu quan trọng. Vallor hiện là Giám đốc Trung tâm "Technomoral Futures" ở Đại học Edinburgh. Cái nhìn và các lập luận của Vallor tạo nên một khung tham chiếu quan trọng trong việc hiểu AI không chỉ là công nghệ, mà còn là một hiện tượng văn hóa.

Vallor lập luận rằng nguy cơ thực sự của AI không nằm ở việc nó thay thế hay tiêu diệt loài người, mà ở việc AI đang góp phần làm suy giảm giá trị tư duy và tự chủ của con người. Ẩn dụ "chiếc gương" được Vallor sử dụng để nhấn mạnh rằng AI chỉ phản chiếu những gì con người lập trình, không hề có trải nghiệm hay độ sâu.

Quan điểm này được Vallor minh họa khi so sánh: "Khi bạn vào phòng tắm để đánh răng, bạn biết rằng không có một khuôn mặt thứ hai nhìn lại bạn. Đó chỉ là sự phản chiếu của khuôn mặt, và nó có những thuộc tính rất khác biệt. Nó không có sự ấm áp, không có chiều sâu”.

Vallor chỉ rõ rằng AI, đặc biệt là các mô hình ngôn ngữ lớn (LLMs), không thực sự "suy nghĩ" mà chỉ bắt chước trí tuệ. Cô phản bác Geoffrey Hinton, người cho rằng AI có thể hiểu nghĩa và cảm xúc, khi nhấn mạnh rằng các tuyên bố này đã đơn giản hóa và bóp méo khái niệm tư duy. Vallor nhắc lại: "Hinton đã đi quá xa khi nói về tri thức và trải nghiệm... Thực tế không hề có mối liên hệ nào thực sự”.

Trong khi Vallor phê phán việc thay đổi định nghĩa trí tuệ tổng quát nhân tạo (AGI) của các nhà lãnh đạo công nghệ như Sam Altman, cô câu hỏi liệu chúng ta có đang nhìn nhận công nghệ qua một ống kính hẹp hòi với tư duy thủ công nghiệp không. Việc so sánh AGI với "máy nướng bánh" có thể nghe hài hước nhưng cực kỳ sát với thực tế cách AI đang được áp dụng. Altman đã "đã thay đổi mục tiêu và cho rằng AGI là một cỗ máy có thể thực hiện tất cả các nhiệm vụ kinh tế có giá trị mà con người làm được”.

Shannon Vallor nhấn mạnh rằng AI và câu chuyện xung quanh nó đang tái định nghĩa trí tuệ con người một cách sai lệch. Âm hưởng của AI đôi khi bị phóng đại đến mức khiến con người nghi ngờ khả năng suy nghĩ và quá trình tự nhận thức của chính mình. Vallor bổ sung: "Tôi nghĩ rằng AI đang đặt ra một mối đe dọa khá cấp bách đối với ý nghĩa tồn tại của cuộc sống con người... AI đang làm suy yếu cảm giác về bản thân chúng ta như những sinh vật trí tuệ có trách nhiệm và tự do trong thế giới này”.

Văn hóa công nghệ hiện nay, nhất là ở Thung lũng Silicon, đang tôn thờ các giá trị như hiệu quả và tối ưu hóa. Vallor cảnh báo rằng điều này có thể làm lu mờ những nguyên tắc nhân văn cần thiết cho một sự phát triển công bằng. "Văn hóa Thung lũng Silicon có những đặc điểm giống tôn giáo. Nó không thể bị lay chuyển bởi bằng chứng phản bác hay lý lẽ”.

Là một người theo dõi AI sát sao, tôi đồng tình với những nhận định này và cho rằng, trong lúc chúng ta hỗ trợ AI, cần phải duy trì một cái nhìn phê phán và cân nhắc. AI không nên chỉ là một công cụ kinh tế, mà còn là một đối tượng nghiên cứu văn hóa, xã hội và triết học. Việc định hướng AI phù hợp sẽ làm gia tăng giá trị cho xã hội mà vẫn duy trì những giá trị nhân bản./.